Autonome systemer

Ett steg nærmere autonomi

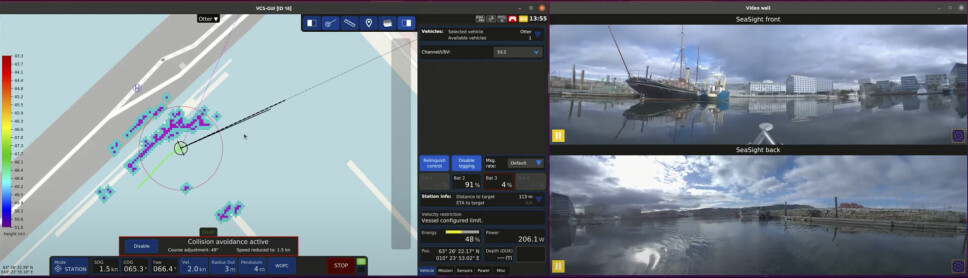

Maritime Robotics har med et nyutviklet system for situasjonsforståelse og å unngå kollisjoner, tatt et langt steg nærmere fullt selvkjørende farkoster.

Denne artikkelen er 2 år eller eldre

«Seasight» er det betegnende navnet på Maritime Robotics nye SA (Situational Awareness) og COLAV (Collision Avoidance) system, som utnytter bl.a. LiDAR, radar og AIS sammen med høyoppløselige kamera for å gi økt trygghet og fjernstyringsmuligheter i ubemannede farkoster – og med full 360° dekning.

- Allerede verdensledende

- Maritime Robotics´ programvare Autonomy Onboard er allerede verdensledende. Den ekstra SA-kapasiteten som SeaSight gir er det naturlige, neste steg i evolusjonen innen ubemannede farkoster, sier Runar Olsen, produktansvarlig for USV-ene (Uncrewed Surface Vehicles) Otter og Otter X. SeaSight er for øvrig laget som en plug-and-play løsning som kan brukes på alle selskapets farkoster som bruker Autonomy Onboard.

Finner sikker vei

SeaSight fungerer som et hjelpesystem for operatøren, og skal forbedre sikkerhet og sanntids situasjonsforståelse. Når Collision Avoidance er aktivert, vil det ubemannede fartøyet unngå alt som kan være i fare for å forstyrre operasjonen. Dette kan være land, kai, fartøy, bøyer, dyr, sjøplanter eller andre gjenstander som oppdages. Hvis det ubemannede fartøyet ikke er i stand til å finne en sikker passasje til det forespurte stedet, vil det automatisk gå inn i «stasjonsmodus» og avvente operatørinstruksjoner.

Flerkamerasystem

- SeaSight har flere lysfølsomme HD-kameraer. Vi kombinerer og balanserer videostrømmene fra disse for å gi operatøren en totaloversikt over omgivelsene. På større fartøyer bruker vi også termiske (IR) kameraer for synlighet under dårlige lysforhold og mørke, forklarer Olsen.

LiDAR og AIS

I tillegg til den kamerabaserte SA-funksjonaliteten, har SeaSight aktive sensorer som LiDAR og AIS. Den 360-grader skannende LiDAR-sensoren som brukes av SeaSight, brukes først og fremst i den avanserte algoritmen for kollisjonsunngåelse. LiDAR-sensoren brukes også til å visuelt forbedre situasjonsoversikten under dårlige siktforhold.

Kunstig intelligens

- For å opprettholde vår posisjon som en ledende leverandør av innovative, ubemannede løsninger, søker vi kontinuerlig etter måter å utvikle disse løsningene ytterligere. Vi har kraftig beregningsmaskinvare i form av en GPU-prosessor innebygd i SeaSight som vi planlegger å utvide med kunstig intelligens (AI) basert behandling av bildedata. Spesialtrente nevrale nettverk vil gi robust deteksjon og klassifisering av skip og andre fartøyer samt andre navigasjonshensyn, fremholder Olsen, som understreker at selskapet fokuserer på å bruke de aller nyeste teknologiene i sine løsninger.

Sensorfusjon

De mest avanserte versjonene av SeaSight vil også utnytte sensorfusjon mellom de oppdagede og sporede objektene fra video (dagslys og termisk), LiDAR, Radar og AIS. - Disse svært sikre deteksjonene vil spores og estimeres over tid og gi Autonomy Onboard-motoren en best mulig situasjonsbevissthet og forståelse, forklarer Olsen. Autonomimotoren vil dermed kunne beregne den optimale USV-oppførselen for å navigere trygt.

Automatiserer oppgaver

Alle interessante objekter, slik som båter, vil bli merket og visualisert for operatøren som informasjon som overlegger videostrømmen og/eller kartet. Kun de viktigste detaljene vises til operatøren for å unngå overbelastning av informasjon. Dette forbedrer situasjonsforståelsen for operatøren og viser også tydelig hvordan USV fungerer og årsaken til eventuelle avvik sammenlignet med kommandert oppførsel. Collision Avoidance- systemet kan enkelt aktiveres og justeres til operasjonsområdet.

Steg for steg

– Det ultimate målet er jo fullt autonome farkoster som kan navigere trygt på sjø og vannveier, uten brukerinnblanding og i samsvar med det internasjonale regelverket for å forhindre kollisjoner på sjøen (COLREGS), poengterer Olsen. – Vi bygger denne funksjonaliteten, steg for steg, avslutter han.